现象 datax执行hdfsreader->mysqlwriter的时候发现

2w+task 然后oom。

首先思考下为啥又2w+task,说明有2w+文件,未免也太多了

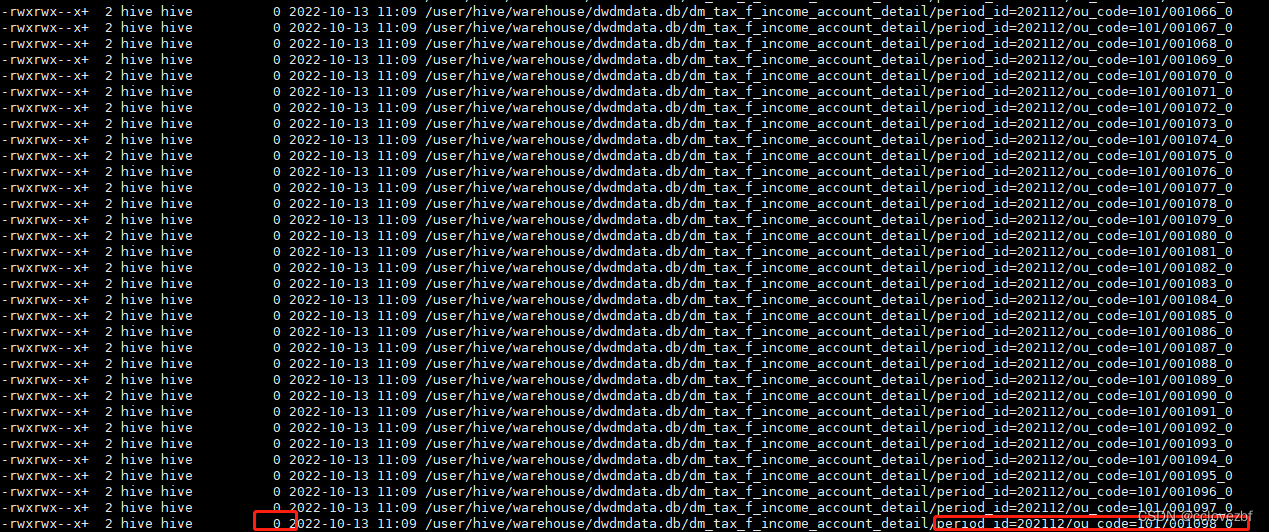

检查hdfs目录

分区/子分区/1000个文件

为什么会有这么多分区呢?

按道理spark 会自动merge小文件的,为啥没有merge呢?以前我都测试是ok的呀

set hive.merge.size.per.task=268435456;

set hive.merge.sparkfiles=true;

猜测:

1.spark merge 对分区表不起作用?

2.spark merge 对空文件不起作用。

上述就是空文件,暂时不测试了。有时间的时候更新下。本来想着下次更新,但是想了下,问题也不复杂,继续研究下。

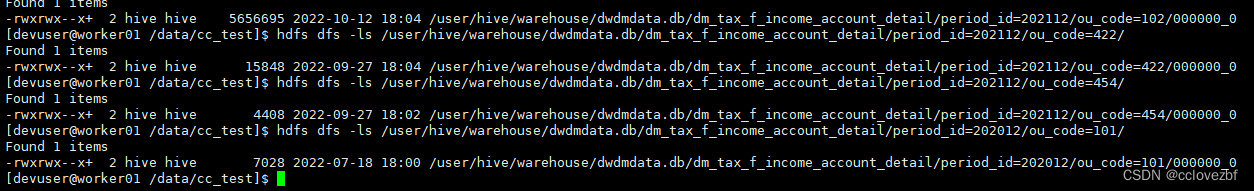

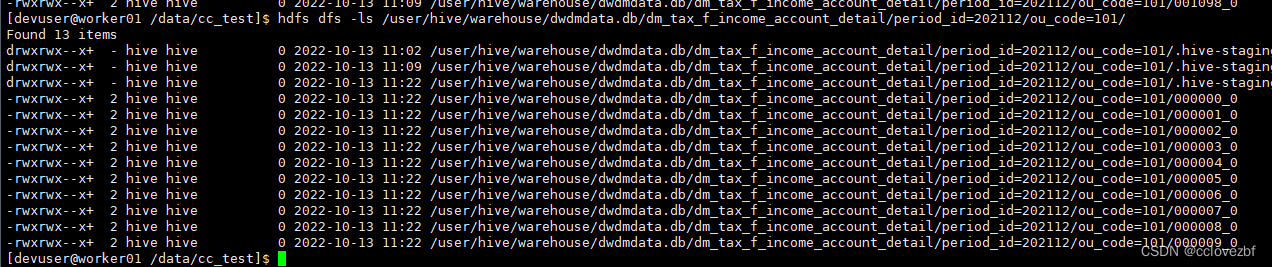

我发现其余分区的数据

查看他们的目录都很正常。

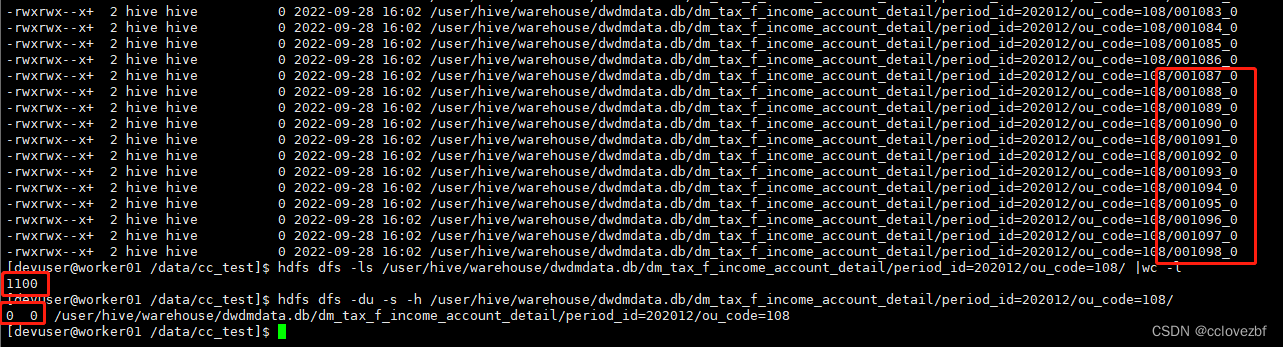

但是那些分区数据为空的就不正常了

但是那些分区数据为空的就不正常了

说明了啥,spark.merge 是针对非空文件去merge的或者说这个参数起效,一个目录下必须有一个非空文件,我这几个目录都是1000个空文件,所以根本不merge。

主要来说明怎么解决空文件过多的问题

也很简单,我们知道生成文件的个数=task的数量

直接set mapreduce.job.reduces=10

最后结果也ok 10个空文件比1000个能够接收。

但是这样也会有一定的问题,reduce只有10个速度效率会有所下降