模型简介

DeepSeek-V3是DeepSeek团队开发的新一代专家混合(MoE)语言模型,共有671B参数,在14.8万亿个Tokens上进行预训练。该模型采用多头潜在注意力(MLA)和DeepSeekMoE架构,继承了DeepSeek-V2模型的优势,并在性能、效率和功能上进行了显著提升。

使用场景

DeepSeek-V3模型适用于多种自然语言处理任务,如文本生成、问答系统、文本摘要等,能够生成高质量的语言内容并支持多语言对话。此外,它在数学推理、代码生成等复杂任务中表现出色,可广泛应用于教育、商业决策和编程辅助等领域。

评测效果

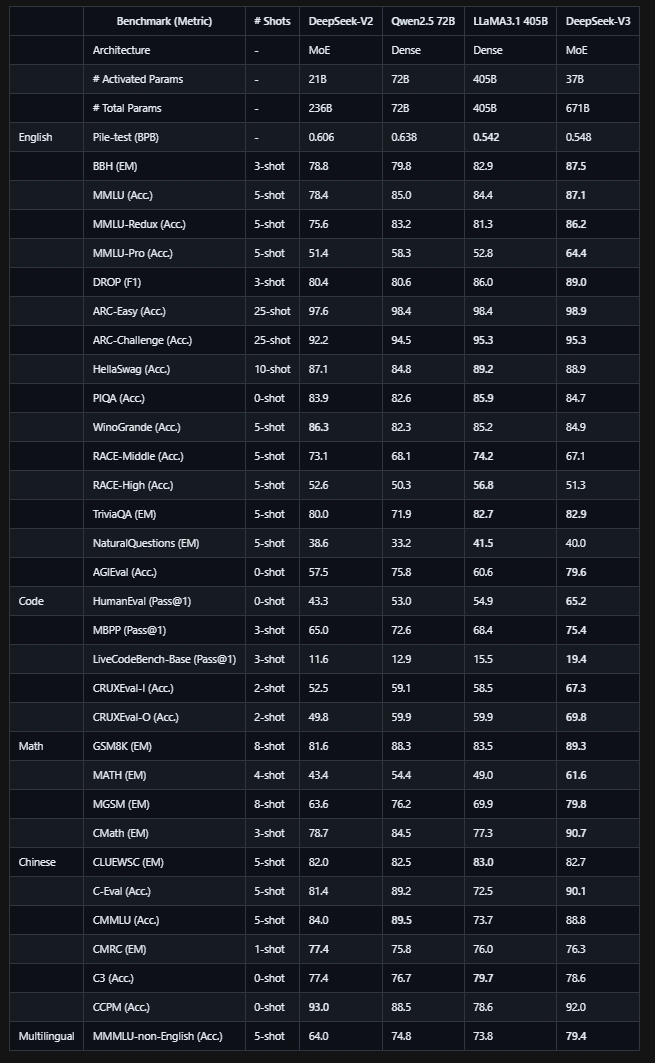

基础模型评估

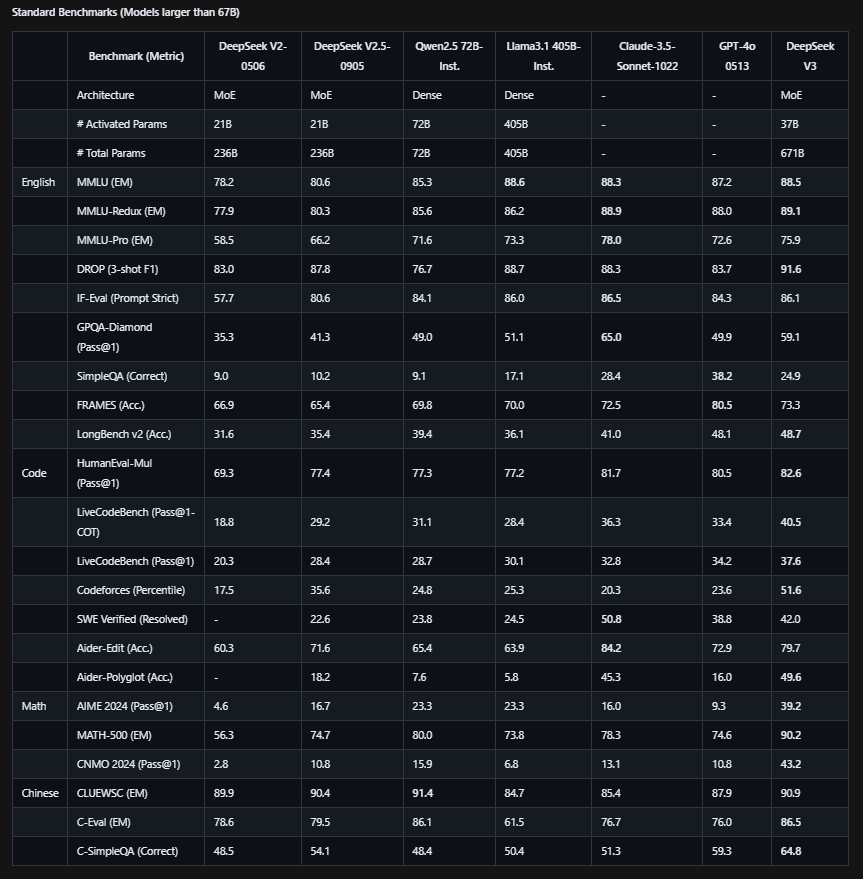

聊天模型评估

注:所有模型均在将输出长度限制为8K的配置中进行评估。包含少于1000个样品的基准使用不同的温度设置进行多次测试,以获得可靠的最终结果。DeepSeek-V3是性能最佳的开源模型,并且与前沿的闭源模型相比也表现出有竞争力的性能。

技术亮点

创新的负载均衡策略和训练目标

- 除了DeepSeek-V2的高效架构之外,DeepSeek-V3开创了一种用于负载均衡的辅助无损策略,该策略可以最大限度地减少因鼓励负载均衡而引起的性能下降。

- 多标记预测(MTP)目标,并证明它对模型性能有益,可用于推理加速的推测解码。

迈向终极训练效率

通过算法、框架和硬件的协同设计,克服了跨节点MoE训练中的通信瓶颈,几乎实现了完全的计算-通信重叠。显著提高训练效率并降低了训练成本。

DeepSeek-R1的知识提炼

引入了一种创新方法,将长链思维(CoT)模型的推理能力,特别是DeepSeek R1系列模型之一的推理能力、验证和反射模式整合到DeepSeek-V3,显著提高了它的推理性能。

版本列表

| 版本列表 | 版本说明 |

|---|---|

| DeepSeek-V3 | DeepSeek-V3是DeepSeek团队开发的新一代专家混合(MoE)语言模型,相比前代DeepSeek-V2模型,在性能、效率和功能上有显著提升。 |

相关资源及引用

相关资源

- 使用DeepSeek-V3 Base/Chat模型需遵守模型许可证。

- DeepSeek-V3系列(包括Base和Chat)支持商用。

相关引用

@misc{deepseekai2024deepseekv3technicalreport,

title={DeepSeek-V3 Technical Report},

author={DeepSeek-AI and Aixin Liu and Bei Feng and Bing Xue and Bingxuan Wang and Bochao Wu and Chengda Lu and Chenggang Zhao and Chengqi Deng and Chenyu Zhang and Chong Ruan and Damai Dai and Daya Guo and Dejian Yang and Deli Chen and Dongjie Ji and Erhang Li and Fangyun Lin and Fucong Dai and Fuli Luo and Guangbo Hao and Guanting Chen and Guowei Li and H. Zhang and Han Bao and Hanwei Xu and Haocheng Wang and Haowei Zhang and Honghui Ding and Huajian Xin and Huazuo Gao and Hui Li and Hui Qu and J. L. Cai and Jian Liang and Jianzhong Guo and Jiaqi Ni and Jiashi Li and Jiawei Wang and Jin Chen and Jingchang Chen and Jingyang Yuan and Junjie Qiu and Junlong Li and Junxiao Song and Kai Dong and Kai Hu and Kaige Gao and Kang Guan and Kexin Huang and Kuai Yu and Lean Wang and Lecong Zhang and Lei Xu and Leyi Xia and Liang Zhao and Litong Wang and Liyue Zhang and Meng Li and Miaojun Wang and Mingchuan Zhang and Minghua Zhang and Minghui Tang and Mingming Li and Ning Tian and Panpan Huang and Peiyi Wang and Peng Zhang and Qiancheng Wang and Qihao Zhu and Qinyu Chen and Qiushi Du and R. J. Chen and R. L. Jin and Ruiqi Ge and Ruisong Zhang and Ruizhe Pan and Runji Wang and Runxin Xu and Ruoyu Zhang and Ruyi Chen and S. S. Li and Shanghao Lu and Shangyan Zhou and Shanhuang Chen and Shaoqing Wu and Shengfeng Ye and Shengfeng Ye and Shirong Ma and Shiyu Wang and Shuang Zhou and Shuiping Yu and Shunfeng Zhou and Shuting Pan and T. Wang and Tao Yun and Tian Pei and Tianyu Sun and W. L. Xiao and Wangding Zeng and Wanjia Zhao and Wei An and Wen Liu and Wenfeng Liang and Wenjun Gao and Wenqin Yu and Wentao Zhang and X. Q. Li and Xiangyue Jin and Xianzu Wang and Xiao Bi and Xiaodong Liu and Xiaohan Wang and Xiaojin Shen and Xiaokang Chen and Xiaokang Zhang and Xiaosha Chen and Xiaotao Nie and Xiaowen Sun and Xiaoxiang Wang and Xin Cheng and Xin Liu and Xin Xie and Xingchao Liu and Xingkai Yu and Xinnan Song and Xinxia Shan and Xinyi Zhou and Xinyu Yang and Xinyuan Li and Xuecheng Su and Xuheng Lin and Y. K. Li and Y. Q. Wang and Y. X. Wei and Y. X. Zhu and Yang Zhang and Yanhong Xu and Yanhong Xu and Yanping Huang and Yao Li and Yao Zhao and Yaofeng Sun and Yaohui Li and Yaohui Wang and Yi Yu and Yi Zheng and Yichao Zhang and Yifan Shi and Yiliang Xiong and Ying He and Ying Tang and Yishi Piao and Yisong Wang and Yixuan Tan and Yiyang Ma and Yiyuan Liu and Yongqiang Guo and Yu Wu and Yuan Ou and Yuchen Zhu and Yuduan Wang and Yue Gong and Yuheng Zou and Yujia He and Yukun Zha and Yunfan Xiong and Yunxian Ma and Yuting Yan and Yuxiang Luo and Yuxiang You and Yuxuan Liu and Yuyang Zhou and Z. F. Wu and Z. Z. Ren and Zehui Ren and Zhangli Sha and Zhe Fu and Zhean Xu and Zhen Huang and Zhen Zhang and Zhenda Xie and Zhengyan Zhang and Zhewen Hao and Zhibin Gou and Zhicheng Ma and Zhigang Yan and Zhihong Shao and Zhipeng Xu and Zhiyu Wu and Zhongyu Zhang and Zhuoshu Li and Zihui Gu and Zijia Zhu and Zijun Liu and Zilin Li and Ziwei Xie and Ziyang Song and Ziyi Gao and Zizheng Pan},

year={2024},

eprint={2412.19437},

archivePrefix={arXiv},

primaryClass={cs.CL},

url={https://arxiv.org/abs/2412.19437},

}

免责声明

DeepSeek-V3模型来源于第三方,本平台不保证其合规性,请您在使用前慎重考虑,确保合法合规使用并遵守第三方的要求。