产品定义

更新时间 2025-07-25 10:07:35

最近更新时间: 2025-07-25 10:07:35

本文带您了解什么是弹性负载均衡产品,弹性负载均衡产品的架构,工作原理及其访问方式。

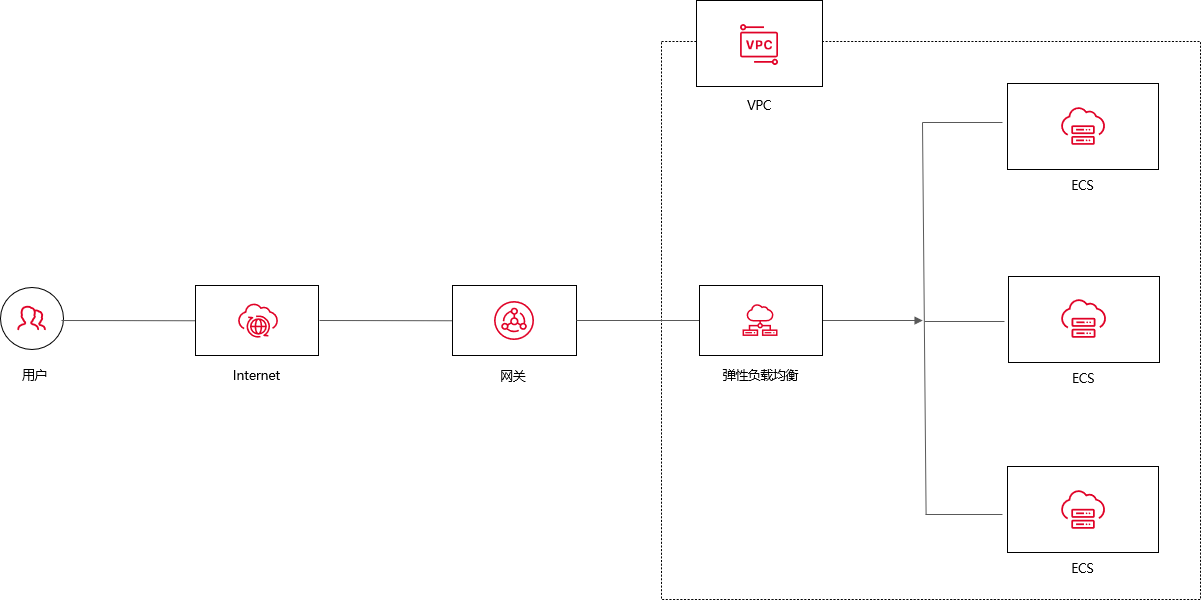

弹性负载均衡(CT-ELB ,Elastic Load Balancing)是一种分发控制网络流量的服务,通过预先设定的算法将访问流量自动分发到多台云主机,扩展应用系统对外的服务能力,实现更高水平的应用系统容错性能。

产品架构

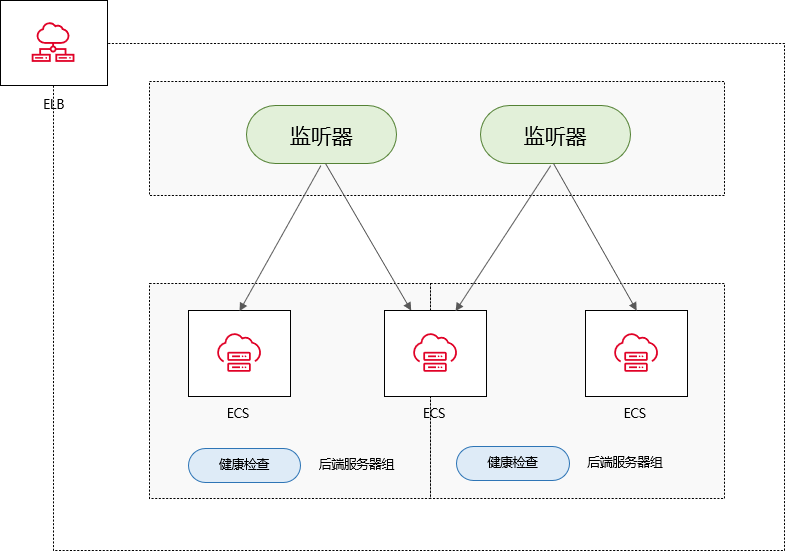

弹性负载均衡的产品架构主要包含以下组件:

- 负载均衡器:即负载均衡实例,可以接收来自客户端的请求流量,并经流量分配到一个或多个可用的后端主机。

- 监听器:监听器是弹性负载均衡的核心组件,监听器指定要监听的协议和端口号,并根据配置的负载均衡算法将请求转发到后端主机。监听器也会对后端主机进行健康检查。

- 后端主机组:每个监听器关联一个后端主机组,后端主机组包含多个后端主机。当监听器接收到客户端请求时,它将请求转发给后端主机组中的一个或多个后端主机。后端主机组负责将请求传递给相应的后端主机,实现负载均衡和高可用性。

- 转发策略:转发策略定义了负载均衡器将流量请求转发给后端主机的方式。

- 访问策略组:访问策略组可帮助您控制访问权限,确保负载均衡器只接收来自指定网络范围的请求,从而提高应用程序的安全性。

- 证书管理:用户将证书上传到负载均衡中,在创建HTTPS协议监听的时候需绑定证书,提供HTTPS服务。

天翼云弹性负载均衡AZ级容灾高可用架构具有如下特点:

- 网元跨AZ多活,单AZ故障,其它AZ承载全部流量

- 集群模式,任意节点故障业务流量自动切换到其它可用节点

- 四七层网元分离,分布式处理,服务可用性更高

- 后端主机支持跨AZ,业务可跨AZ负载

- 支持与弹性伸缩联动,后端主机组根据业务负载自动弹缩主机数量

- 监听器支持转发策略,灵活匹配业务域名、URL转发流量到特定后端主机

工作原理

弹性负载均衡的工作原理如下:

- 客户端发起请求:客户端向负载均衡器发送请求,请求可以是HTTP请求、TCP连接请求或UDP数据包等。

- 负载均衡器接收请求:负载均衡器中的监听器接收到请求后,根据预先配置进行筛选,以确定如何处理该请求。

- 监听器转发请求:监听器会根据配置的负载均衡算法,选择一个或多个后端主机来处理请求。

- 后端主机处理请求:后端主机接收到请求后进行处理,并将响应返回给负载均衡器。

通过以上过程,弹性负载均衡器可以分配客户端请求到多个后端云主机,实现负载均衡和高可用性。

转发策略

监听器可以根据不同的转发策略来决定如何将流量分配给后端主机。以下是天翼云支持的弹性负载均衡转发策略类型:

| 调度算法 | 权重 | 算法策略 |

|---|---|---|

| 轮询 | 调度算法权重算法策略轮询权重取值范围为[1,256] | 根据后端主机的权重, 将流量按照顺序逐个分发给后端主机,每台主机依次接收请求,实现流量均衡。相应的权重表示后端主机的处理性能, 常用于短连接服务。 |

| 最小连接 | 权重取值范围为[1,256] | 将流量分发给当前连接数最少的主机,以确保负载较小的主机能够处理更多的请求。加权最小连接即根据主机的权重和当前连接数来分发流量,常用于长连接服务。 |

| 源算法 | 在非0的权重下,由于使用了源算法,各个后端主机的权重属性将不再生效 | 通过对请求的源IP地址进行Hash运算,可以将其转化为一个具体的数值。同时,后端主机也会被编号。根据Hash运算的结果,将请求分发到对应编号的后端主机上,从而实现了对不同源IP地址的访问进行负载均衡,同时确保同一个客户端IP的请求始终被派发到相同的主机上。 |

访问方式

您可以使用以下方式来访问和管理弹性负载均衡: