知识召回

RAG(Retrieval-Augmented Generation)检索增强生成。是一种结合了检索和生成的自然语言处理模型。它结合了检索式方法和生成式方法的优势,旨在解决生成式模型的困难和不确定性问题,同时利用检索式方法来提供更加准确和可控的生成结果。

RAG模型通常由两个主要组件组成:

-

生成器(Generator):生成器是一个基于生成式模型的组件,通常是一个预训练的语言生成模型,比如GPT。它负责生成文本序列,可以根据输入的上下文和特定的条件生成文本。

-

检索器(Retriever):检索器是一个用于从大规模知识库中检索相关信息的组件,通常使用一种检索式方法,比如使用向量检索或者基于检索的问答系统。检索器根据输入的查询,从知识库中检索出相关的文本片段或者信息。主流的是从向量知识库里检索

RAG模型的工作流程通常如下:

- 接收输入查询或者上下文。

- 使用检索器从知识库中检索相关信息。

- 将检索到的信息与输入的上下文结合,输入到生成器中。

- 生成器根据综合的信息生成文本序列。

RAG模型的优势在于,通过结合生成式模型和检索式方法,它可以在生成文本时借助外部知识库提供更加准确和相关的信息,从而生成更加合理和丰富的文本内容。这种结合可以有效地提高生成式模型的性能和可控性,使其在各种自然语言处理任务中取得更好的效果。

向量知识库里检索

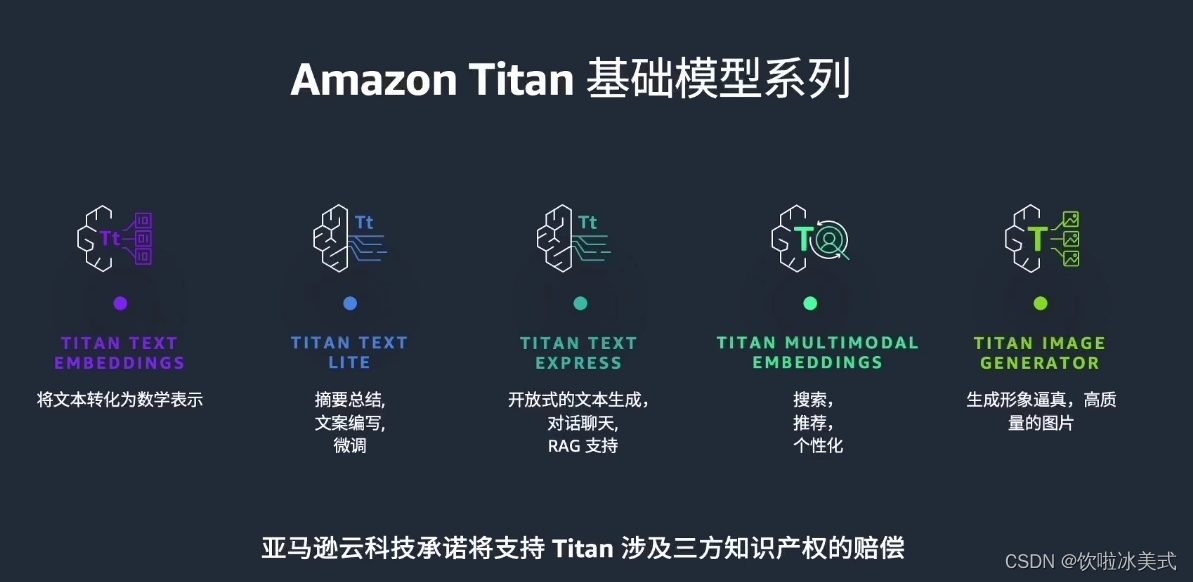

将文本信息转换为向量表示,并使用这些向量来表示文本之间的语义相似性或相关性

1、嵌入模型保存:

- 对于预训练的嵌入模型(如Word2Vec、GloVe、FastText等),可以将它们的参数保存下来,以便在需要时使用。这些模型会学习将每个单词映射到一个高维空间中的向量表示,这些向量可以用于表示单词之间的语义相似性。

-

选择合适的向量表示方法:

- 根据任务需求和数据特点选择合适的向量表示方法。常见的方法包括词嵌入模型(如Word2Vec、GloVe、FastText)、文档向量化模型(如Doc2Vec)或深度学习模型(如BERT、Transformer)等。

-

训练或加载预训练模型:

- 如果选择使用预训练的向量表示模型,需要加载模型并进行训练。对于一些模型(如Word2Vec、GloVe等),可以直接加载已经训练好的模型参数。

-

将文本转换为向量表示:

- 对于每个文本数据,利用选择的向量表示方法将其转换为对应的向量表示。这可以是单词级别的向量表示,也可以是文档级别的向量表示。

-

存储向量表示数据:

- 将每个文本及其对应的向量表示存储到数据库或文件中。可以使用数据库管理系统(如MySQL、MongoDB等)来创建表格,并将文本及其向量表示存储在对应的字段中。如果选择存储到文件中,可以选择常见的数据格式如CSV、JSON等。

-

建立索引(可选):

- 如果数据量较大,可以考虑建立索引以加快检索速度。数据库管理系统通常提供了建立索引的功能,可以根据需要选择适当的字段建立索引。