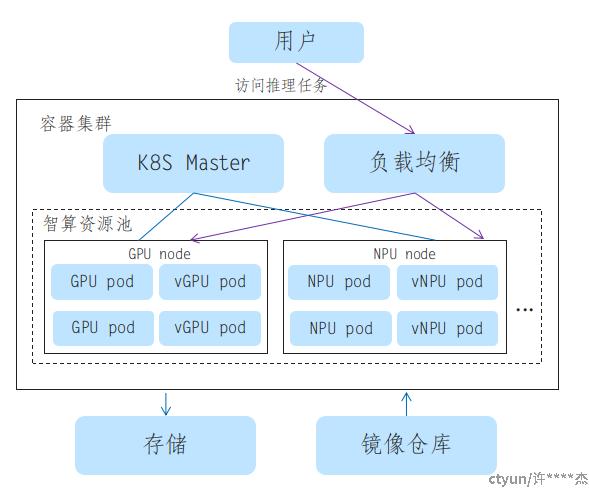

随着人工智能、大模型等技术在各行业的探索和发展,基于云原生AI技术的智算平台和产品为客户提供了高效的异构资源调度及模型训练、推理等服务能力。本文简要介绍一种云原生AI解决方案。

基于容器引擎+AI的云原生套件解决方案,可以提供GPU算力显存切分、HPA弹性伸缩等能力,实现低成本的推理服务快速上线。

1、方案架构:

2、解决方案给客户带来的主要价值:

统一异构算力管理

对IaaS各种异构计算资源(如NPU/vNPU、GPU/vGPU等)进行统一管理、运维和调度分配。

实现业务负载弹缩

提供多种推理服务workload类型,并支持根据业务自定义负载策略自动弹性扩缩容。

提升GPU资源利用率

把多个模型推理任务部署到同一块GPU,通过共享GPU显存和算力资源,提高资源利用率,降低业务成本。