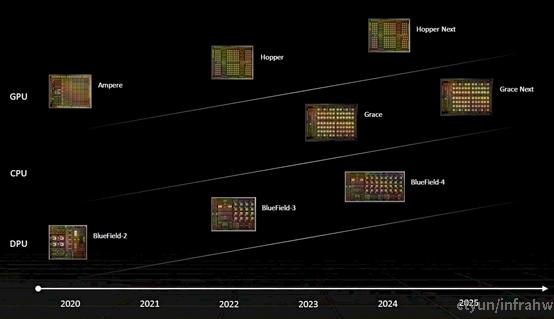

NV发布产品路线图:

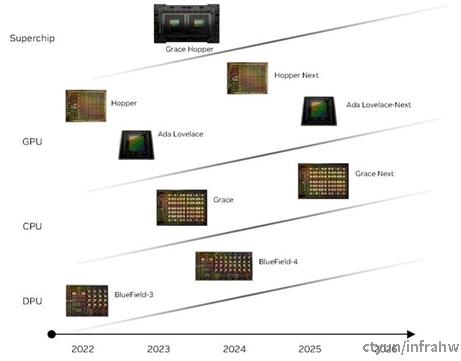

以下是今年早些时候发布的路线图的更新,其中添加了用于人工智能推理、可视化和元宇宙处理卡的“Lovelace”GPU 系列:

如果过去的趋势是未来趋势的指标——当芯片制造商向其超大规模和云构建商客户承诺两年推出一次的节奏时,它们肯定应该是未来趋势的指标,就像英伟达几年前所做的那样——那么我们绝对期待新架构的 Blackwell GB100 GPU 加速器将于明年 3 月至 5 月左右推出。但正如您在下面所看到的,Nvidia 主要 GPU 发布的节奏通常不到两年。所以这是一种回归形式。

以下是数据中心 GPU 在过去 11 年中的推出方式,数据中心 GPU 计算至关重要:

“开普勒”K10 和 K20,2012 年 5 月

“开普勒”K40,2013 年 5 月

“Kepler”K80,单卡上有两个 GK210B GPU

“Maxwell”M40,2015 年 11 月,主要用于 AI 推理,并非真正用于 HPC 或 AI 训练

“帕斯卡”GP100,2016 年 4 月

“Volta”GV100,2017 年 5 月(原始 Pascal 的某些功能直到 Volta 才出现)

“安培”GA100,2020 年 5 月

“漏斗”GH100,2022 年 3 月

“Hopper-Next”H200,2024年春季?

“Blackwell”GB100,2024年夏季还是秋季?

“Xavier”GX100,2025年春夏

我们很清楚,Hopper-Next 应该是 Blackwell GB100 GPU,而现在路线图上的 GH200 是一种权宜之计,试图转移人们对 AMD“Antares” Instinct MI300X GPU 和 MI300A 混合显卡的注意力。 CPU-GPU 设备,看起来将于 12 月推出。AMD 将在这些设备上拥有 HBM 内存容量和带宽优势,以及用于 CPU 和 GPU 的聚合内存,而 Nvidia 不能告诉所有人H100NVL 双倍卡就是答案。

因此,有两种方法可以使用即将推出的 Hopper-Next H200 GPU。我们赞成但仅基于预感的一个是 Nvidia 测试将两个 Hopper GH100 GPU 放入一个插槽中 - 因为它已经使用其 Arm 服务器 CPU 与其 Grace-Grace 超级芯片配合使用。我们在一年半前建议它这样做。该芯片的性能可以稍微降低,以获得更合适的功率范围,并留出空间来容纳更高的 HBM3e 内存堆栈,从而提高目前数据中心非常缺乏的内存与计算比率。

GPU 插槽中的芯片数量并不像每个插槽中的带宽那么重要。每个插槽需要两个 GPU,但内存带宽需要四倍、六倍或八倍才能真正领先并提高 GPU 的性能。我们半开玩笑地说:拥有一半 Hopper GPU 可能更有意义——称之为 Hop?– 如果您确实想提高 AI 工作负载的性能,则需要 2 倍的内存容量和 2 倍的内存带宽。

有些人认为H200只是内存升级,在相同的GH100 GPU上提供2倍的内存容量和2倍的内存带宽。我们认为会对它进行一些调整,并且可能会进行更深层次的垃圾分类,以至少提高性能。

这个路线图中还有另一件令人烦恼的事情:根据 Nvidia 的最新路线图,未来的 Blackwell GB100 GPU 和 B100 加速器到底什么时候出现?你看到上面有日期吗?我们推测是在 2024 年末,但 Blackwell 仍有一定的余地可以推迟到 2025 年初。(我们认为 Blackwell 芯片很可能以伊丽莎白·布莱克威尔 (Elizabeth Blackwell)命名,她是第一位获得医学学位的女性在美国(在纽约州北部的日内瓦医学院,现在是雪城大学的一部分),也是第一位在英国总医学委员会医学登记册上登记的女性。)

无论如何,Blackwell GB100 GPU 都非常接近 GX100 GPU(我们将其代号为“Xavier”),预计将于 2025 年推出,我们认为是在今年晚些时候,但也可能不是。(除了漫威超级英雄宇宙中虚构的查尔斯·泽维尔之外,我们找不到姓氏以 X 结尾的重要著名科学家,是的,我们知道 Nvidia 已经在其嵌入式系统之一中使用了该代号.“X”可能只是意味着它是一个变量,而 Nvidia 尚未决定有一个代号。)

我们认为 Nvidia 需要更多时间来调整 Blackwell 的 GPU 架构,并且考虑到 AI 模型变化的速度,如果事情很重要,例如 Volta 的 Tensor Cores 或稀疏性,Nvidia 应该这样做是合理且正确的支持是针对 Ampere,或者 Transformation Engine 和 FP8 是针对 Hopper。

解决这个问题后,我们对当前的 Nvidia 路线图有一些需要挑选的地方。例如,BlueField DPU 发生了什么?DPU 是 Nvidia 硬件堆栈不可或缺的一部分,提供网络、安全和虚拟化卸载,并将超级计算机转变为多租户云。Hopper GPU 是在 2022 年 3 月的春季 GTC 会议上宣布的,而不是在 2023 年,并且也在 2022 年末发货。H100 NVL 和 Lovelace L40 失踪了。“Ampere”A100 于 2020 年问世,而不是 2021 年。Quantum 2 400 Gb/秒 InfiniBand 和 400 Gb/秒 Spectrum-3 以太网于 2021 年发布,并于 2022 年(而不是 2023 年)开始发货。速度为 800 Gb/秒以太网和 InfiniBand 的运行速度比我们在 2020 年 11 月与 Nvidia 交谈时的预期晚了大约一年。顺便说一句,上一代 200 Gb/秒 Quantum InfiniBand 于 2016 年发布,并于 2017 年发货。那里存在很大的差距,因为所有试图推销从 200 Gb/秒到 400 Gb/秒的跳跃的公司都存在这个差距。